کرویت

کرویت

مقدمه

معمولا آزمون ANOVA با اندازه گیری های مکرر (فاکتورهای درون سوژه ای (within-subject factors)) در معرض نقض فرض کروی بودن هستند.

کرویت یا کروی بودن (Sphericity) شرایطی است که در آن واریانس تفاوت بین تمام ترکیبات گروه های مرتبط برابر است. نقض کرویت زمانی است که واریانس تفاوت بین تمام ترکیبات گروه های مرتبط برابر نباشد.

کرویت را می توان به همگنی واریانس ها در ANOVA بین سوژه ها تشبیه کرد.

نقض کرویت برای ANOVA اندازه گیری های مکرر جدی است.

این نقض باعث آزاد شدن بیش از حد آزمون (یعنی افزایش میزان خطای نوع I) میشود.

بنابراین، تعیین اینکه آیا کرویت نقض شده است یا نه، بسیار مهم است.

خوشبختانه، اگر نقض کرویت رخ دهد، اصلاحاتی برای تولید یک مقدار F بحرانی معتبرتر (یعنی کاهش در افزایش میزان خطای نوع I) وجود دارد.

این با تخمین درجه نقض کرویت و اعمال یک ضریب تصحیح برای درجات آزادی توزیع-F (F-distribution) به دست می آید.

بعداً در این آموزش در این مورد با جزئیات بیشتری صحبت خواهیم کرد. در ابتدا، ما کروی بودن را با یک مثال نشان خواهیم داد.

نمونه ای از کرویت

برای نشان دادن مفهوم کروی به عنوان برابری واریانس تفاوتهای بین هر جفت مقادیر، دادههای ساختگی را در جدول 1 زیر تجزیه و تحلیل میکنیم. این داده ها از یک مطالعه ساختگی است که ظرفیت هوازی (واحد: ml/min/kg) را در سه نقطه زمانی (Time1، Time2، Time3) برای شش سوژه اندازه گیری کرد.

اولاً، از آنجایی که ما به تفاوت بین گروه های مرتبط (نقاط زمانی) علاقه مندیم، باید تفاوت بین هر ترکیب گروه مرتبط (نقطه زمانی) را محاسبه کنیم (سه ستون آخر در جدول بالا). هر چه نقاط زمانی (یا شرایط) بیشتر باشد، تعداد ترکیبهای ممکن بیشتر میشود. برای سه نقطه زمانی، ما سه ترکیب مختلف داریم. سپس باید واریانس هر گروه را محاسبه کنیم، که دوباره در جدول بالا ارائه شده است.

با نگاهی به نتایج ما، در نگاه اول، به نظر می رسد که واریانس بین تفاوت های دو نقطه زمانی برابر نیست (13.9 در مقابل 17.4 در مقابل 3.1). واریانس تفاوت بین زمان 2 و زمان 3 (Time3-Time2) بسیار کمتر از دو ترکیب دیگر است.

این ممکن است ما را به این نتیجه برساند که داده های ما فرض کروی بودن را نقض می کند.

با این حال، ما میتوانیم دادههای خود را برای کرویت با استفاده از یک آزمون رسمی به نام آزمون کرویت موچلی (Mauchly’s Test of Sphericity) آزمایش کنیم.

آزمون کرویت موچلی

همانطور که قبلاً ذکر شد، آزمون کرویت موچلی روشی رسمی برای آزمایش فرض کرویت است.

اگرچه این آزمایش به شدت مورد انتقاد قرار گرفته است، اما اغلب در تشخیص انحراف از کرویت در نمونههای کوچک و تشخیص بیش از حد آنها در نمونههای بزرگ شکست خورده است، با این وجود این یک آزمون رایج است.

این احتمالاً به دلیل چاپ خودکار آن در SPSS برای ANOVA اندازه گیری های مکرر و فقدان یک آزمون در دسترس است. اما با وجود این کاستی ها به دلیل پرکاربرد بودن آن در این قسمت به توضیح آزمون و نحوه تفسیر آن می پردازیم.

آزمون کروی بودن Mauchly این فرضیه صفر را آزمایش می کند که واریانس تفاوت ها برابر است.

بنابراین، اگر آزمون کرویت موچلی از نظر آماری معنیدار باشد (p<0.05)، میتوانیم فرضیه صفر را رد کنیم و فرضیه جایگزین را بپذیریم که واریانسهای تفاوتها برابر نیستند (یعنی کرویت نقض شده است). نتایج حاصل از آزمون کرویت Mauchly در زیر برای دادههای مثال ما نشان داده شده است (بخش قرمز زیر را ببینید):

نتایج این آزمایش نشان می دهد که کرویت نقض نشده است (p = 0.188) (شما باید زیر ستون “Sig.” را نگاه کنید).

بنابراین میتوانیم نتیجه آزمایش کرویت موچلی را به صورت زیر گزارش کنیم:

آزمون کروی بودن Mauchly نشان داد که فرض کروی بودن نقض نشده است

ممکن است متوجه اختلاف بین نتیجه آزمون کرویت موچلی شده باشید، که نشان میدهد فرض کرویت نقض نمیشود و در حالی که تفاوتهای زیاد در واریانسهای محاسبهشده قبلی (13.9 در مقابل 17.4 در مقابل 3.1)، نشاندهنده نقض فرض کرویت بود.

متأسفانه این یکی از مشکلات آزمون Mauchly در برخورد با حجم نمونه کوچک است که قبلاً به آن اشاره شد.

اگر دادههای شما فرض کروی بودن را نقض نمیکند، نیازی به تغییر درجه آزادی خود ندارید. [اگر از SPSS استفاده میکنید، نتایج شما در ردیف(های) «کرویت فرضی» (sphericity assumed) ارائه میشود.] نقض نکردن این فرض به این معنی است که آماره F (F-statistic) که محاسبه کردهاید معتبر است و میتوان از آن برای تعیین معنیداری آماری استفاده کرد.

با این حال، اگر فرض کروی بودن نقض شود، آماره F دارای سوگیری مثبت است و آن را نامعتبر می کند و خطر خطای نوع I را افزایش می دهد.

برای غلبه بر این مشکل، اصلاحاتی باید در درجات آزادی (df) اعمال شود، به طوری که بتوان یک F-value بحرانی معتبر به دست آورد. لازم به ذکر است که مشاهده اینکه کرویت نقض شده است غیر معمول نیست.

اصلاحاتی که برای مبارزه با نقض فرض کروی بودن با آنها مواجه خواهید شد، تخمین کران پایین (lower-bound estimate)، تصحیح گرینهاوس-گیسر (Greenhouse–Geisser correction) و تصحیح هیون-فلدت (Huynh–Feldt correction) است. این اصلاحات به تخمین کرویت بستگی دارد.

تخمین کرویت (ε) و نحوه کار اصلاحات

درجه ای که کرویت وجود دارد یا نه، با آماره ای به نام اپسیلون (ε) نشان داده می شود.

اپسیلون 1 (یعنی ε=1) نشان می دهد که شرط کروی بودن دقیقاً برآورده شده است.

هرچه اپسیلون بیشتر به زیر 1 کاهش یابد (یعنی ε<1)، نقض کرویت بیشتر می شود.

بنابراین، میتوانید اپسیلون را بهعنوان آماری در نظر بگیرید که میزان نقض کرویت را توصیف میکند.

کمترین مقداری که اپسیلون (ε) می تواند بگیرد، تخمین کران پایین نامیده می شود. هر دو روش Greenhouse–Geisser و Huynh–Feldt تلاش می کنند اپسیلون (ε) را تخمین بزنند، البته به روش های مختلف (این یک تخمین است زیرا ما با نمونه ها سر و کار داریم، نه جمعیت). به همین دلیل، تخمین کرویت (ε) بسته به اینکه کدام روش استفاده می شود، همیشه متفاوت است.

از تخمین کرویت (ε) برای تصحیح درجات آزادی برای توزیع F استفاده میکنند. همانطور که در ادامه این آموزش خواهید دید، مقدار واقعی آماره F در نتیجه اعمال اصلاحات تغییر نمی کند.

پس اصلاحات بر درجات آزادی چه تأثیری دارد؟

پاسخ به این در نحوه محاسبه مقادیر بحرانی برای آماره F نهفته است. اصلاحات بر درجات آزادی توزیع F تأثیر می گذارد، به طوری که از مقادیر بحرانی بزرگتر استفاده می شود (به عنوان مثال، مقدار p افزایش می یابد). این برای مقابله با این واقعیت است که وقتی فرض کرویت نقض می شود، به دلیل کوچک بودن مقادیر بحرانی در جدول F، خطاهای نوع I افزایش می یابد.

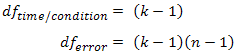

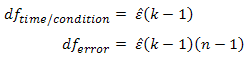

به یاد داشته باید که درجات آزادی مورد استفاده در محاسبه آماره F در ANOVA اندازه گیری های مکرر عبارتند از:

که در آن k = تعداد اقدامات تکرار شده و n= تعداد سوژه ها است.

سه تصحیح تخمین lower-bound، تصحیح Greenhouse–Geisser و تصحیح Huynh–Feldt به صورت زیر همگی با ضرب این درجات آزادی در اپسیلون تخمینی آنها(ε) ، درجات آزادی را تغییر می دهند:

لطفاً توجه داشته باشید که اصلاحات مختلف از نمادهای ریاضی متفاوتی برای اپسیلون تخمینی (ε) استفاده میکنند که در ادامه نشان داده خواهد شد.

همچنین به یاد داشته باشید که آماره F به صورت زیر محاسبه می شود:

همانطور که قبلاً گفته شد، این اصلاحات منجر به یک آمار F متفاوت نمی شود. اما چگونه زمانی که درجات آزادی در حال تغییر است، آمار F بدون تغییر باقی میماند؟

این به این دلیل است که اپسیلون تخمین زده شده به عنوان ضریب درجات آزادی هم برای صورت و هم برای مخرج اضافه می شود و بنابراین آنها یکدیگر را خنثی می کنند، همانطور که در زیر نشان داده شده است:

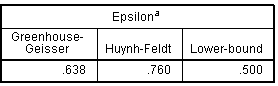

برای مثال، ما سه تخمین اپسیلون (ε) را داریم که به صورت زیر محاسبه شده است (با استفاده از SPSS):

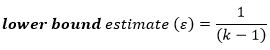

تخمین کران پایین (lower-bound estimate)

کمترین مقداری که اپسیلون (ε) می تواند بگیرد، تخمین کران پایین (یا تنظیم کران پایین) نامیده می شود و به صورت زیر محاسبه می شود:

که در آن k = تعداد اقدامات تکراری است. همانطور که از معادله بالا می بینید، هر چه تعداد اقدامات تکراری بیشتر باشد، احتمال نقض کرویت بیشتر است. بنابراین، برای مثال ما که دارای سه اندازه گیری مکرر است، کمترین مقدار اپسیلون (ε) می تواند باشد:

این نشان دهنده بزرگترین نقض ممکن کرویت است. بنابراین، استفاده از lower-bound estimate به این معنی است که شما درجات آزادی خود را برای “بدترین سناریو” تصحیح می کنید. این اصلاحی را ارائه می دهد که بسیار محافظه کارانه است (به اشتباه فرضیه صفر را رد می کند). این اصلاح با اصلاحات Greenhouse–Geisser و Huynh–Feldt جایگزین شده است. بنابراین تخمین کران پایین دیگر اصلاح توصیه شده نیست.

تصحیح گرینهاوس-گیسر (Greenhouse–Geisser correction)

به منظور تصحیح درجات آزادی توزیع F همانطور که قبلاً ذکر شد، روش Greenhouse–Geisser اپسیلون را تخمین می زند (به عنوان اپسیلون تخمین Greenhouse–Geisser) و در زیر نشان داده شده است:

با استفاده از مثال قبلی، و اگر کرویت نقض شده بود، خواهیم داشت:

بنابراین نتیجه آزمون F ما از F(2،10)=12.534، p=0.002 تا F(1.277،6.384) =12.534، p=0.009 تصحیح می شود (درجه آزادی به دلیل گرد کردن کمی متفاوت است). این اصلاح ارزش معناداری دقیق تری را به دست آورده است. مقدار p را برای جبران این واقعیت افزایش داده است که وقتی کرویت نقض می شود، آزمون بیش از حد آزاد است.

تصحیح هیون-فلدت (Huynh–Feldt correction)

همانند تصحیح Greenhouse–Geisser، تصحیح Huynh–Feldt، اپسیلون را تخمین می زند (به عنوان اپسیلون تخمین هویند-فلد نشان داده می شود) تا درجات آزادی توزیع F را تصحیح کند.

با استفاده از مثال قبلی، و اگر کرویت نقض شده بود، خواهیم داشت:

بنابراین نتیجه آزمون F، از F(2،10)=12.534، p=0.002 تا F(1.520،7.602)=12.534، p=0.005 تصحیح می شود (درجه آزادی به دلیل گرد شدن کمی متفاوت است). همانند تصحیح Greenhouse–Geisser، این تصحیح ارزش اهمیت دقیق تری را به دست آورده است. مقدار p را برای جبران این واقعیت افزایش داده است که وقتی کرویت نقض می شود، آزمون بیش از حد آزاد است.

تصحیح Greenhouse–Geisser در مقابل Huynh–Feldt

زمانی تصحیح Greenhouse–Geisser تمایل به دست کم گرفتن اپسیلون (ε) دارد که اپسیلون (ε) نزدیک به 1 باشد (یعنی یک تصحیح محافظه کارانه است)، در حالی که تصحیح Huynh–Feldt تمایل دارد اپسیلون (ε) را بیش از حد تخمین بزند (یعنی، یک تصحیح لیبرال تر و آزادتر است). به طور کلی، توصیه می شود از تصحیح Greenhouse–Geisser استفاده کنید، به خصوص اگر اپسیلون تخمینی (ε) کمتر از 0.75 باشد. با این حال، برخی از آماردانان استفاده از تصحیح Huynd-Feldt را در صورتی که اپسیلون تخمینی (ε) بزرگتر از 0.75 باشد، توصیه می کنند. در عمل، هر دو تصحیح اصلاحات بسیار مشابهی ایجاد می کنند، بنابراین اگر اپسیلون تخمینی (ε) بزرگتر از 0.75 باشد، می توانید استفاده از هر دو تصحیح را توجیه کنید.

تفسیر پرینت های آماری (Statistical Printouts)

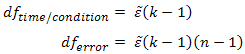

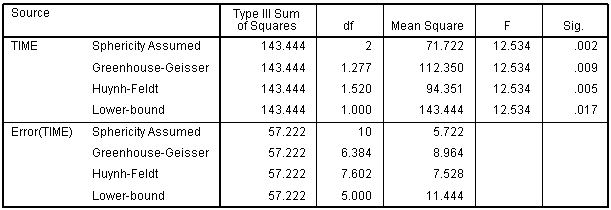

برای مشاهده عملی همه موارد فوق، مجموعه داده هایی را که برای این مقاله استفاده کرده ایم در نظر بگیرید. ما میتوانیم در جدول قبلی ببینیم که برای مجموعه دادههای ما، اپسیلون تخمینی (ε) با استفاده از روش Greenhouse–Geisser 0.638 است (یعنی اپسیلون برآورد Greenhouse–Geisser = 0.638). جدول زیر خروجی ANOVA اندازه گیری های مکرر ما (در SPSS) را نشان می دهد:

خروجی SPSS اندازه گیری های مکرر ANOVA – کرویت

در SPSS، ردیف(های) Sphericity Assumed “کرویت فرضی” جایی است که کرویت نقض نشده است، و بنابراین، نشان دهنده محاسبات عادی است که ما برای محاسبه یک مقدار اهمیت برای ANOVA اندازه گیری های مکرر انجام می دهیم. توجه کنید که چگونه مجموع مربع ها و آماره F بدون در نظر گرفتن اینکه کدام تصحیح اعمال شده است یا خیر یکسان هستند (در شکل زیر با رنگ آبی نشان داده شده است). این بیشتر نشان میدهد که اصلاحات برای تقسیم مجموع مربعها اعمال نمیشوند، بلکه در درجههای آزادی اعمال میشوند.

در نمودار بالا می بینیم که اصلاحات درجات آزادی (df) را تغییر داده است، که به نوبه خود میانگین مجموع مربعات (Mean Sum of Squares) (MS) را هم برای عامل TIME و هم برای خطای آن (Error(TIME)) تغییر داده و سطح معنی داری، آماره F را تغییر داده است.

تحلیل تک متغیره (Univariate) در مقابل تحلیل چند متغیره (Multivariate)

یک روش جایگزین استفاده از MANOVA به جای ANOVA اندازه گیری های مکرر است. دلیل انجام این کار این است که MANOVA به فرض کروی بودن نیاز ندارد. دلایل مختلفی برای انتخاب MANOVA به جای ANOVA اندازه گیری های مکرر و بالعکس وجود دارد،.

برگرفته از وبسایت: افشین صفایی

در چه مواردی استفاده از ضریب استاندارد و غیراستاندارد مفید است؟

نوشته

آزمون اپسیلون گرین هاوس – گیسر Greenhouse – Geisser Epsilon test چیست؟

نوشته

نوشته

مدل معادلات ساختاری (Structural Equation Modeling) — مفاهیم، روشها و کاربردها

نوشته

ضریب استاندارد و غیراستاندارد چگونه در تفسیر نتایج رگرسیون به کار میروند؟

نوشته